作者:Ben Dickson(科技部落格http:// bdtechtalks.com 主理人)

譯者:張雨佳

當你看下面這面這張圖片時,可以很簡單地推斷出不同元素之間的因果關系。例如,你看到球棒和棒球運動員手臂的同步移動,可以自然地想到是運動員的手臂導致了球棒的運動,以及球棒的移動才引起球運動方向的突變。

當然也可以考慮反事實,比如當球飛得更高一點,沒有被球棒擊中時會發生什麽。

這些推論源於人類的直覺。

我們在很小的時候、沒有人明確指導的情況下,就透過觀察世界學到了這些直覺。但對於在圍棋、西洋棋等復雜任務中想要超越人類的機器學習演算法來說,對因果關系的預測仍是一個挑戰。機器學習演算法擅長從大量數據中找出精巧的模型,尤其是深度神經網路。它們可以實作即時的轉錄音訊、每秒標記數千張影像和視訊幀,或者檢查x光和核磁共振掃描中是否有癌癥。但卻很難像人類一樣,自然地推斷出上面棒球視訊中存在的簡單因果關系。

Max Planck智慧系統研究所、蒙特婁學習演算法研究所(Mila)和谷歌研究所的研究者們在一篇名為「Towards Causal Representation Learning」的論文中認為,用機器學習模型對因果表示還有很多挑戰,但如何構建能夠學習因果表示的AI系統,已經有了一些曙光初現的方向。

獨立同分布的數據

首先回答這個關鍵的問題——為什麽機器學習模型不能在自己的領域外或訓練數據外起作用?

論文總結道:「動物經常使用的資訊,在機器學習的過程中卻常常被忽略,比如對世界的幹預、地域轉移或者時間結構。因為機器學習認為這些因素是無用的,並試圖將它們丟掉。據此,目前大多數機器學習都比較成功,歸結於對適當收集的獨立同分布(independent and identically distributed,i.i.d.)數據進行大量的模式辨識。」

這個機器學習中經常使用術語i.i.d.,它假設在問題空間中的隨機觀測之間不相互依賴,並且發生的機率是恒定的。最簡單的例子就是拋硬幣或擲骰子,每一次拋或投擲的結果都獨立於之前的結果,並且每一種結果的機率保持不變。

當在更復雜的電腦視覺等領域中套用時,機器學習工程師試圖透過在非常大的樣本集上訓練模型,從而將問題轉變到i.i.d.領域。假設有足夠多的樣本去訓練,機器學習模型就能夠將問題的一般分布規律編碼到模型參數中。

但現實情況中,由於無法考慮和控制訓練數據中的所有因素,分布往往會發生變化。例如,已經訓練了數百萬張影像的摺積神經網路,當影像中物體遇到了新的光照條件、從略微不同的角度或新的背景下進行測試時,就很可能會失敗。

訓練數據集中的物體vs現實世界中的物體(來源:objectnet.dev)

解決上述問題的主要方法,是在更多的樣本上訓練機器學習模型,但隨著環境越來越復雜,透過增加訓練樣本的方法也很難覆蓋整個樣本分布。

尤其是在機器人、自動駕駛汽車等人工智慧必須與世界進行互動的領域,面對的挑戰更加嚴峻。無法對因果關系進行理解的機器學習模型,就很難做出準確的預測或者處理新問題。這就是為什麽自動駕駛汽車在經過數百萬英裏的訓練後,仍然會犯一些奇怪和危險的錯誤。

「要讓機器學習模型在i.i.d.領域之外也起作用,不僅需要學習變量之間的統計關聯,還需要學習潛在的因果模型」,論文寫道。

因果模型允許人們將以前獲得的知識套用到新的領域。例如,當你學會玩【魔獸爭霸】這種即時戰略遊戲後,就可以快速地將知識套用到【星際爭霸】和【帝國時代】等其他類似的遊戲中。

然而,機器學習演算法中的遷移學習只能起到非常簡單的作用,比如將影像分類器參數微調以檢測新型別的物件。而當機器學習模型套用在電子遊戲等更復雜的任務中時,則需要數千年的遊戲訓練,並且很難對微小的環境變化(更換新地圖或對規則的進行微調)做出適當的調整。

「在學習因果模型時,我們應該用較少的樣本來訓練,讓大多數模組化的知識可以在不經過重新訓練的情況下使用」。

因果學習

為什麽i.i.d. 有這些已知的弱點,卻仍然是機器學習的主導形式?

你可以透過添加訓練數據來提高模型的精度,也可以透過增加算力加速訓練過程。實際上,深度學習能取得成功的一個關鍵原因,就是有更多的可用數據和更強大的處理器。

並且,基於i.i.d.的模型也更容易評估:先選取一個大數據集,將其分成訓練集和測試集。然後用訓練集調整模型,用測試集上的預測準確度驗證模型的效能。之後一直訓練直到模型實作預期的準確度。

現在有很多可用的公共數據集,比如ImageNet、CIFAR-10和MNIST。還有針對特定任務的數據集,如診斷covid-19的COVIDx數據集和威斯康辛州乳癌診斷數據集。因此,對於所有任務來說挑戰都是相同的:設計一個可以根據統計規律預測結果的機器學習模型。

但AI研究者也在他們的論文中觀察到,準確的預測能力往往不足以為決策提供幫助。

比如在新冠病毒流行期間,許多用統計規律而不是因果關系訓練的機器學習系統開始失敗,並且隨著現真實模式的改變,模型的準確性也隨之下降。

但當問題的統計分布改變時,因果模型卻仍然是穩健的。

例如,當你第一眼看到某個物體時,大腦就會下意識地去除光照因素。這就是為什麽你在新的光照條件下,仍然可以認出這個物體的原因。

因果模型還允許我們對從沒見過的情況做出反應,並思考反事實。比如我們不用把車開下懸崖,就知道會發生什麽。反事實就可以減少機器學習模型所需的訓練樣本數量。

因果關系在應對對抗性攻擊時也很重要,因為一些微小的幹擾都會讓機器學習系統以意想不到的方式失敗。

論文作者寫到,「這些攻擊顯然違反了基於統計的機器學習的i.i.d.假設」,並且無法應對對抗性攻擊的弱點證明了,機器學習演算法的魯棒性機制與人類智慧還有很大差距。研究人員還指出,因果關系可能可以防禦對抗性攻擊。

對抗性攻擊的目標是機器學習對i.i.d.的敏感性。在上圖中,給熊貓影像上添加一層難以察覺的噪音,摺積神經網路就會錯判為長臂猿。

廣義上說,因果關系可以增強機器學習的泛化能力。研究人員寫到:「事實上,當前大多數為了解決i.i.d.基準問題的實驗和大多數在i.i.d.設定中進行泛化的理論結果,都不能解決跨問題泛化這個嚴峻挑戰。」

在機器學習中加入因果關系

AI研究者們已經整合了一些對於構建因果機器學習模型至關重要的概念和原則。

其中有兩個概念:「結構因果模型」和「獨立因果機制」,它們表明AI系統不應該只是尋找表面的統計相關性,而是應該能夠辨識因果變量,並去除它們對環境的影響。

這種機制可以使模型在不同的視角、背景、光線和噪音下都能夠正確檢測物件。理清這些因果變量將有助於AI系統更加穩健地應對不可預測的變化和幹預。因此,因果AI模型就不需要龐大的訓練數據集了。

因果機器學習論文的作者寫到,「無論是透過外部人類知識還是機器學習過程,只要得到了因果模型就可以得出幹預、反事實和潛在結果的影響」。

作者還探討了如何將這些概念套用於強化學習等機器學習的其他分支,使智慧代理可以不依靠大量的探索環境和試錯就能發現問題。由於因果結構允許模型在訓練剛開始就有根據的做出決定,而不是采用隨機和不合理的決策,所以可以使強化學習的訓練更加有效。

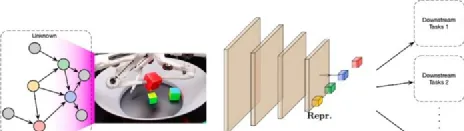

因此,研究者們為結合機器學習機制和結構因果模型的AI系統提供了新思路:「為了將結構因果建模(SCM)和表示學習相結合,我們應該將SCM嵌入到輸入和輸出是高維非結構化的大型電腦器學習模型中,但至少模型中有一部份工作是由神經網路調整過參數的SCM完成的。最終獲得的模型可能具有模組化的架構,不同的模組可以單獨調整用於不同的新任務。」

這些概念就更接近於人類思維的模組化方法,比如我們知道大腦的不同領域和區域會聯系和使用不同的知識和技能。

透過將因果圖與機器學習相結合,AI代理在少量訓練樣本的情況下就可以構建套用於不同任務的模組

需要註意的是,本文想法是在概念層面上提出的。而真正要實作這些概念面臨著以下挑戰:「(a)很多時候,我們需要從現有的底層特征中推斷出抽象的因果變量;(b)對於哪種型別的數據揭示了因果關系沒有達成共識;(c)通常在訓練和測試集上的實驗方案,不足以推斷和評價現有數據集中的因果關系。我們可能需要獲得更多的環境資訊和幹預措施,建立新的基準;(d)即使在我們擅長的領域中,也經常缺乏可延伸的、數值上合理的演算法。」

不過也有許多研究人員從一些現有工作領域中獲得了靈感。

這篇論文參考了被稱為「貝葉斯網路之父」的圖靈獎獲得者Judea Pearl的工作,他以因果推理方面的工作而聞名,也曾直言不諱地批評了純深度學習方法。而且這篇論文的另一位作者Yoshua Bengio也是圖靈獎得主,是深度學習的先驅之一。

論文中的一些想法還與Gary Marcus提出的混合AI模型相重疊,它將符號系統的推理能力與神經網路的模式辨識能力相結合。但這篇論文並沒有直接提到結合後的混合系統。

該論文也符合邏輯分析系統system 2深度學習——Bengio在2019人工智慧大會(NeurIPS 2019)上提出的概念。system 2深度學習的理念是構造一種能從數據中學習更高層表示的神經網路框架。而高層表示對於因果關系、推理和遷移學習都非常重要。

雖然還不清楚提出的哪種方法可以解決機器學習的因果關系問題,但只要互相沖突、不同來源的觀點匯聚在一起,就會碰撞出有趣的結果。

最後,作者認為:「深入來講,i.i.d.模式辨識只是一種數學抽象,而因果關系對於大多數生命體來說都是必不可少的一部份。到目前為止,機器學習一直忽略了對因果關系的全部整合,但我們認為,整合因果概念很有可能讓機器學習受益。」