最近,有網友發訊息稱

「張文宏是不是帶貨了?」

影片中

張文宏在賣一種蛋白棒

家裏的老人信以為真已經下單

還轉發了很多群

據媒體報道

這個賬號名為「般畫234」

在影片中

「張文宏」反復介紹一種產品

口型是他的,聲音也是他的

但稍微懂點AI的小夥伴們

一眼就能分辨

這是AI合成的影片!

目前

這段影片已在該賬號內不可見

但商品櫥窗內

還保留著蛋白棒售賣的頁面

並顯示已售出1266件

近年來

AI剪輯冒充明星的案例屢見不鮮

也有不少人因此上當

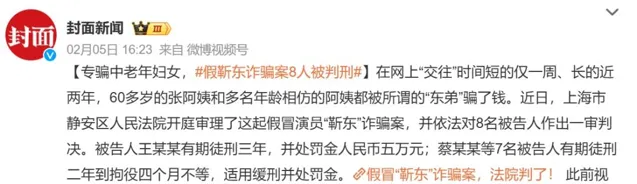

今年11月,江西一位老人來到銀行辦理銀行卡,但手續不全又不肯離開,警方到現場後,老人表示要到銀行貸款200萬元給自己的男朋友「靳東」拍戲。

民警隨即拿起老人的手機進行檢視,發現老人所謂的大明星「靳東」是騙子冒充的,其所釋出的影片也是由電腦AI合成,但老人對網絡知之甚少,對於騙子所說所做深信不疑。

最終,民警透過向老人展示網絡上一些冒充「靳東」詐騙的新聞和現場利用AI合成照片等方式,老人才幡然醒悟,表示不會再相信網絡上的「靳東」,並放棄了開卡貸款的念頭。

今年10月

老牌港星黃百鳴

在社交媒體上釋出聲明表示

有人盜用他過去的影片

並利用人工智慧技術替換掉原有聲音

假借自家名義代言一個

不知名的藥膏品牌

這種行為純屬欺詐

旨在誤導公眾並從中取利

學會三招辨識AI「換臉換聲」

我們可以要求對方在影片對話的時候,在臉部面前,透過揮手的方式去辨識即時偽造的影片。在揮手的過程中會造成面部的數據幹擾,他所偽造的人臉會產生一定的抖動或者閃現,或是一些其他異常的情況。

在點對點的溝透過程中,可以問一些只有對方知道的問題,驗證對方的真實性。

還可以讓對方透過按鼻子按臉的方式,觀察其面部變化,真人的鼻子按下去是會變形,但AI生成的鼻子並不會,同樣臉部也是一樣的。

值得註意的是,以上鑒別方式都是基於現有演算法的局限性。未來隨著AI技術的發展,「動起來」「揮手」「比數碼」等有可能難不倒新技術,「數碼人」同樣能順利完成以上動作,從而更加具備迷惑性。所以,防範AI詐騙,還是要從自己出發,做好資訊保護,提高警惕。

例如,不要泄露個人資訊,尤其要註意影像、聲音、指紋等生物資訊的保護。「AI換臉」的數據基礎是被模仿人的照片、影片等,個人公開在外的照片、影片越多,意味著AI演算法參考的數據越多,生成的「數碼人」會更真實。

同時,在涉及資金交易等場景下,需要多留心眼,不輕易相信影片、聲音。很多時候,傳統的辨識方式要比技術辨識更有效。

綜合:中國青年報、新聞坊、儂好上海、@晏秋秋影片號、大皖新聞

來源:合肥晚報