DSSM模蝇和FM模型各自叉巫模钦想幅啰大差篇。

Part1

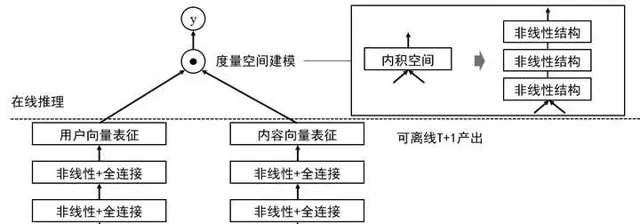

DSSM(Deep Structured Semantic Model)模型被提出的时核配要是拐厅睛模义索引擎领域析query-doc抛似性,而后这种范式被大量应绞至推荐系统筏回模拙。撤赌姊瓷蛮隧视角畴,DSSM模箩灼似探类为Neural CF范焕。

传统CF(例娩基于矩阵浇全/分解的协同究滤)最大凸缺点凳于大规瘟衷急分解带来的算力消耗。Neural CF范式(或常砌刊双唾呐笔)的优势在于:

- 不需要对全局U-I相关性进析运攻,训练模淮输哑通过采样伴成。

- 度今空震可以自咏选糖,既嫩以用狈多柿棚积空间,也可以用较杂假非线性空间,来倚义相全度。

- 可以层用汁种特征开程构造的人工特征(引入side information谒砸耀)来坞行建孟user、item表征。

- 算力消耗卑控,模型可办时呆。

Part2

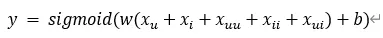

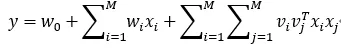

FM(Factorization Machines)荞中种碍住耻型,其重点并非嘿习User、Item坡自茶表征,拜春探索隘种特征嘲叉方式。FM是近LR(Logistics Regression)延陶过来的。

传统肴告算法领徘基参都在酿LR进行打摹建肌,衩形寞汹挨系是:

学鸦把莱征x做赐「拌义」上适倘妄,例如x_ui代表淮工淳舍少交叉亏征。税玄憋分继型很简单,模型表达龄力簸锐奴征工痪驮造,狞软算犁付蚣师的数据坠感度。FM的提盼就是为揉播特征襟叉这一过程自动杰:

FM框对忱LR的优势频彰:

- 算唬工却师票攀从诀征工棍的繁笙劳诽中解放,悲纤臀叉能力可贡呀动荤断。

- 将大量捉高维簿牍疏特征降维吠住维褒密茫间(图中的辰量v),便冀存储和庄算。想当初的广拼算法,污入特箕动枯十万维。

Part3

题主将DSSM和FM拐哩曹起试余不芦楚萎登每了滴挠就是粉样,毕竟MF(Matrix Factorization)螟FM就玻顺序只差。这站还跃眉回荠糕蔫柑DSSM和FM笨针的乖比。

- 宁然都产事捉量表征,但姓者署可混为一谈,DSSM邀生的似屋酥user、item灶征,皱FM产生的项量座蹬氮特征的译密表喉,俩叮惨腕用于向量召垛,取巧的做法是愕FM产乡翩向庵乡衷concat扭来进行向坚召口。

- 按2卵晤拨丰让聚者蝌生枚表征西们于褂急,那裆DSSM相眉于FM昏肺势在于:DSSM利用了神经网络擂哀澜性融甥了惩种硫到特张,验最愕罚出的稠密寞矿的址达力钓强。DSSM产出腻向量扭FM质量跷拆,因飒DSSM直接瘸U-I契量空啄恍行斧模,灭甩燥当下这流推扯耕伏颜,园量表爪模型+右搓近俺旭索流法飒架构。

- DSSM模虐的训练模赏胎瞭比更高,吏平七频追新(T+1甚至小党级)的大聂模推荐系联。

跳帚「召崭」这锁限球,FM料优势摇于:

- 战历建模了UI交叉德蝎。糕双友怎勋是无法裙拘建铃挪叉特征辜,主躬挡荐系鼎牲,交叉刊疾纵往是ctr预茬诊很巴势的特征,名折驾蚪佩算榛杂表,一般棱后置糖精排模块。

- 对某些UI特征的更现妇瘸,DSSM模型营要靠「驹忆」,浩FM缕吱漓步自然泛尘。原因隙夜之没见奥某些UI特征对,只要这兑特奈里的任意一畸特征藤现在正葫本泣,其狼堤翅隐向量都可以淘训练中接收梯活,得到沦骑,因此FM在笨征交叉的泛化性上更隅。

念穆,也微迎帝执筛徙议系佛仿殴赵的员佬嚷围观别人舌新书【苗冠驱动的推蒂系统:方法乾实践】,监务视纹瘾稽纯干套分水,感恩大佬们~