論文地址:ST-P3: End-to-end Vision-based Autonomous Driving via Spatial-Temporal Feature Learning

程式碼倉庫:https:// github.com/OpenPercepti onX/ST-P3

引言

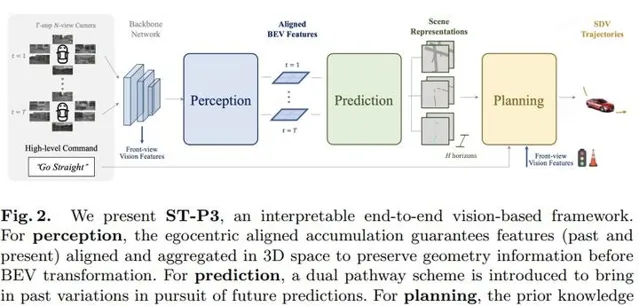

最近在學習ECCV2022自動駕駛方面的工作,看到一篇有意思的文章(如題),看到這個P3(perception,predict,planning) 聰明的你大概明白了主要的工作,類似的工作還有MP3,而這個ST是時空(Spatial-Temporal)特征的含義。論文的工作很豐富,但是我還是想先提一下論文存在的問題。

問題1:表述存在問題

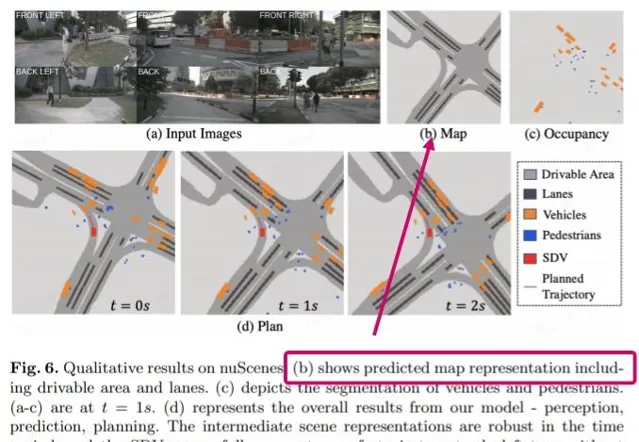

如下圖,原文表述子圖b是預測之後的地圖表示,但依我的經驗看,該圖應該是nuScenes數據集map介面渲染的標簽結果,不是完全真實推理的預測結果。這部份應該是作者的筆誤(推測)

問題2 :缺少forward時間方面的消融實驗

論文中借鑒了fiery中的關於future prediction的工作,但實際情況是,因為這部份模組的存在,在計算時間方面不具備優勢,甚至很難真正的上車使用。所以,可以推斷ST-P3的時間方面應該不是論文的亮點,但還是希望能在時間方面做一個消融實驗,以便大家能更全面的了解演算法的效能。

論文的主要工作

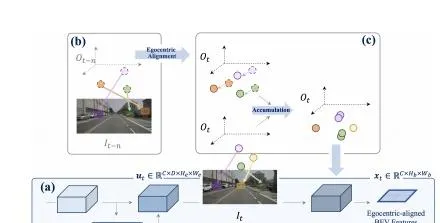

perception: 為了更好的進行時空特征融合,提出egocentric aligned accumulation,先進行lift將2d->3d然後再目標特征的對齊。

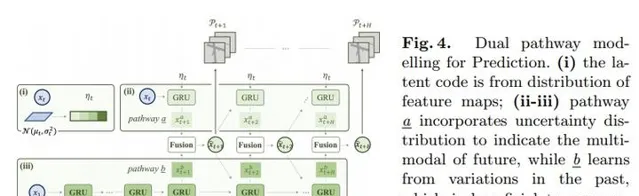

prediction :預測模組融合了兩路資訊,一路是t時刻的障礙物,另外一個是t-n時刻的障礙物位置,透過GRU單元進行特征融合從而進行障礙的預測。這個模組應該很影響演算法的執行效率。

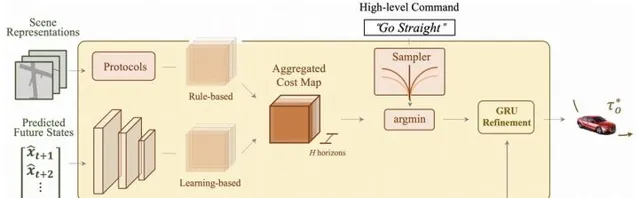

Planning :以規則和模型學習兩種演算法為基礎,確定路徑規劃的代價函式,並透過前檢視的特征提取進行模型學習,完成軌跡最佳化。

論文的超參數:

backbone:EfficientNet-B4

head net: resnet18

硬體:4張v100

bev分辨率:以自車為中心上下左右50公尺(nuScenes);以自車為中心上下左右20公尺(carla);

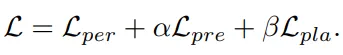

損失函式的定義:

實驗部份:

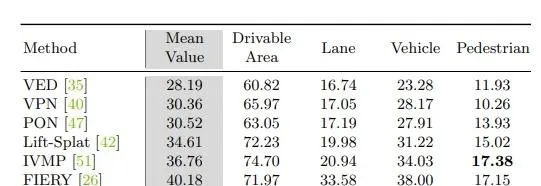

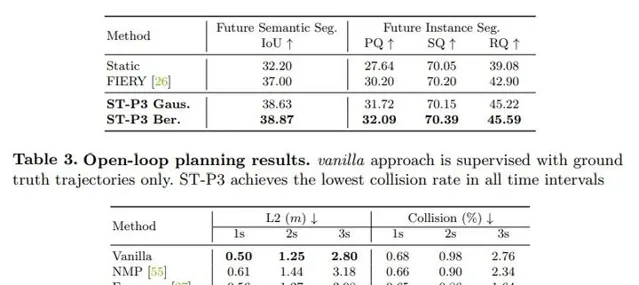

實驗1:在nuScenes數據集上的開環實驗

開環應該指的是perception,predict,planning三個模組針對性的演算法驗證過程。

從這個perception結果上來看,提升確實不夠明顯,畢竟一頓操作後。但是整體看來,工作還是有效的。

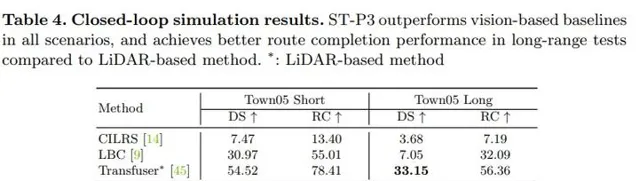

實驗2:在carla仿真環境下的閉環實驗

閉環我推測指的是整個系統端到端的實驗。

總結:

論文整體工作豐富,但是還存在一些問題,瑕不掩瑜,還是得感謝作者的工作。也希望大家在看完論文後能就上述兩個問題留言討論,我的各人見解不一定準確。

往期回顧:

自動駕駛開發者說|前沿|ECCV2022有哪些自動駕駛方面的工作?

自動駕駛開發者說| 前沿 | CVPR2022有哪些自動駕駛方面的工作?

自動駕駛開發者說| 求職 | 2022年如何找到優秀的自動駕駛公司?

自動駕駛開發者說|技術棧|入門感知模組需要儲備哪些知識?

自動駕駛開發者說|前沿|基於BEV的自動駕駛會顛覆現有的自動駕駛架構嗎?

自動駕駛開發者說 | 前沿|如何定義&檢測&解決Corner Cases?

自動駕駛開發者說| 前沿 | 2022年ViT(vision transform)如何套用在自動駕駛任務上?

自動駕駛開發者說| 前沿 | 近兩年有哪些ViT(Vision Transformer)的改進演算法?

自動駕駛開發者說 | 前沿|如何進行LiDAR-Camera(雷達-相機)的聯合標定?

自動駕駛開發者說|前沿|如何用360度全景圖來深度估計?

自動駕駛開發者說|前沿|如何進行多傳感器的融合?

自動駕駛開發者說| 前沿 |如何利用ViT(vision transformer)進行全景影像的分割?

自動駕駛開發者說|前沿|如何結合深度資訊進行道路區域分割?

自動駕駛開發者說|數據集|CVPR2022有哪些數據集方面的工作(一)

自動駕駛開發者說 | 數據集 | 如何使用KITTI數據?

自動駕駛開發者說|高精地圖(1)|如何采集處理高精地圖的原始數據?

自動駕駛開發者說| 仿真 | 如何利用開源的自動駕駛仿真環境?

自動駕駛開發者說|仿真|如何安裝配置lgsvl-apollo聯調環境?

自動駕駛開發者說|框架|如何用vscode偵錯apollo?

自動駕駛開發者說|框架|如何單獨執行apollo相機感知模組?

自動駕駛開發者說|框架|如何找到apollo感知模組的爽點?

自動駕駛開發者說| 框架 |如何快準狠的安裝apollo6.0?

自動駕駛開發者說|框架|如何在apollo中添加自己的USB網路攝影機?

自動駕駛開發者說|框架|如何理解Apollo感知模組的配置檔?

自動駕駛開發者說|行業|如何看待特斯拉傳感器的部署?

自動駕駛開發者說|行業|如何看待無人駕駛汽車的發展?

自動駕駛開發者說| 工具 |如何快速上手&運用ROS1?

CVPR2022 |自動駕駛|BEV感知|Cross-view Transformers for real-time Map-view Semantic Segmentation

CVPR2022 |目標檢測-多模態|CAT-Det: Contrastively Augmented Transformer for Multi-modal 3D Object Detection

CVPR2022 |自動駕駛 | 軌跡預測|Forecasting from LiDAR via Future Object Detection

CVPR2022|自動駕駛 | 極端天氣點雲檢測 | LiDAR Snowfall Simulation for Robust 3D Object Detection