潮新聞客戶端 記者 朱高祥

圖片來源:網路截圖

張文宏開始直播帶貨了?

近日,不少網友發現,疑似知名醫生張文宏正在售賣一種蛋白棒,家中老人信以為真而大量下單。但仔細辨認可以發現,帶貨視訊為AI合成。張文宏本人回應稱,這些假的AI合成資訊就像蝗災一樣,一次又一次發生,像漫天飛過來的蝗蟲一樣害人。

不僅是張文宏,網路上的「AI名人」已成泛濫趨勢。「假靳東」迷倒一眾大媽、「假雷軍」辣評世間百態、「假拜登」宣布第三次世界大戰開始、「假馬克龍」直播回答「政府聘用滅霸」……

而更早之前的南韓Deepfake(深度偽造)性犯罪事件,不僅讓南韓全體女性陷入「換臉恐慌」,更是引發全球關註,大眾擔心一種更廣泛的、充滿敵意的網路環境開始滲入真實世界。人工智慧方興未艾,公眾該如何面對新一代的施虐者?

Deepfake就在你我身邊

妍妍(化名)從未想過Deepfake會發生在自己身上。

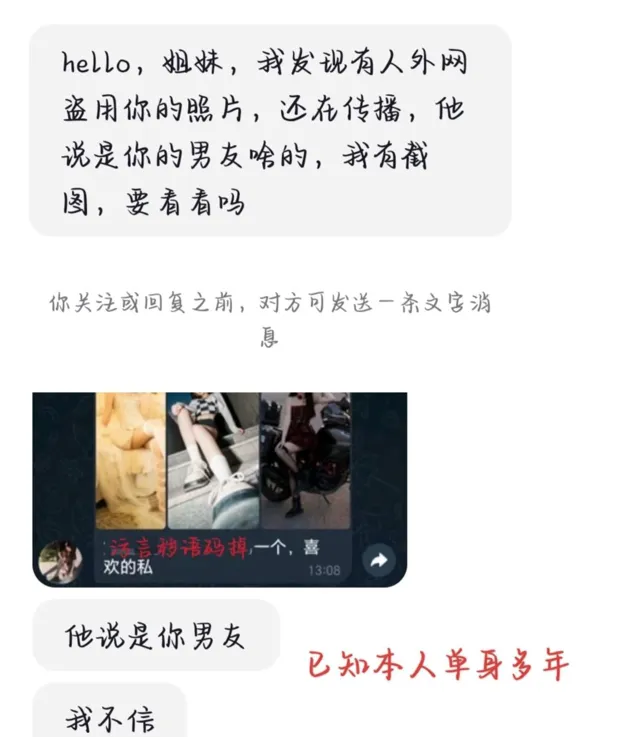

今年7月9日的一天,正在刷抖音的妍妍突然收到了一條私信,被網友告知有自稱其男友的人在外網盜用她的照片後進行AI換臉並傳播。

圖源受訪者

「我聽到這個訊息之後有些震驚且不敢相信,但真的看到這些照片後,我感到無比的憤怒。」妍妍告訴記者,對方不僅制作大量AI換臉的不良照片與視訊,還隨意泄露了自己的個人資訊,包括網名、真名、年紀、學校、專業等等。

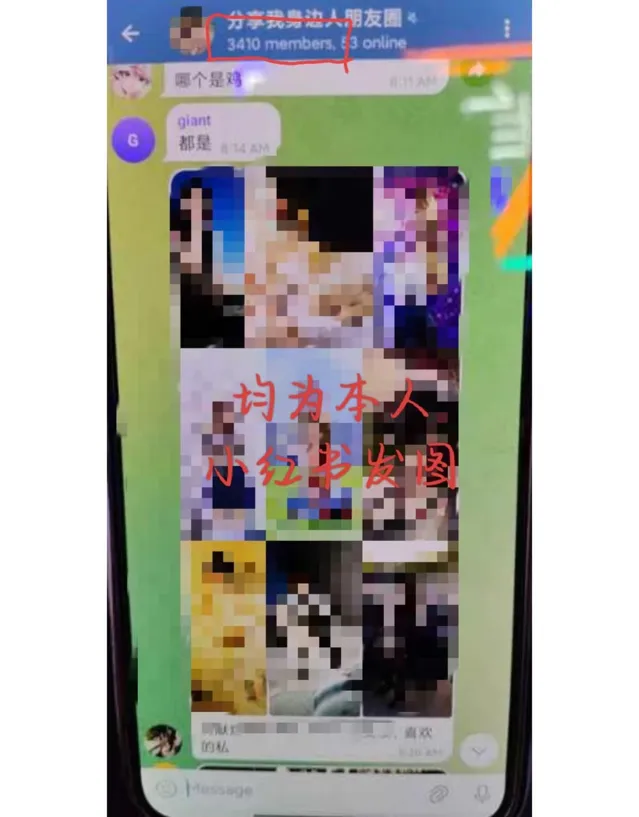

妍妍隨後透過多個途徑進行了查證,這些照片和視訊均是對方從自己的小紅書搬運,經加工處理,制作出不堪入目的色情影像。妍妍第一時間選擇了報警並咨詢了律師,在他們的建議與幫助之下開始固定更多證據。

圖源受訪者

「當天晚上8點多,我報警備案,當時我沒有排除熟人或者陌生人的各種可能性。後續我經過各種帳號套話,得知對方了解我的家屬關系等更私密的資訊,我就逐步縮小了嫌疑人範圍,心中也有了懷疑的物件。」妍妍隨後釋出了一條僅對方可見的朋友圈,且把內容做了特殊標記,很快這條內容出現在外網。

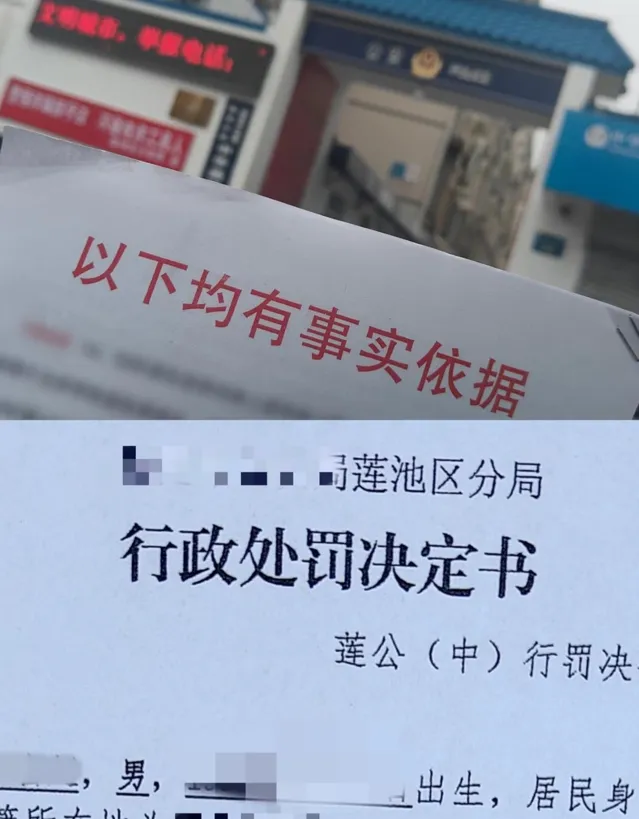

妍妍把這條直接證據交給了警方,也於不久後得知了警方的處理結果:以治安管理處罰法中傳播淫穢物品罪判處行政拘留十日。

圖源受訪者

「沒想到Deepfake離自己如此之近,也沒想到身邊的熟人也會成為侵害自己的罪犯。」妍妍說,在處理這件事情的過程中,自己了解到身邊有很多女孩子在遭受類似的事件,甚至更嚴重。她們被泄露個人私密、被造謠、被AI換臉、被性騷擾等等。

妍妍告訴記者,因為自己的經歷,短暫接觸過幾個軟體,上面有成百上千的群組,群組裏多的有上萬人,裏面內容不堪入目,充斥著各種女生的AI換臉照片與視訊,以及汙蔑、詆毀、造謠的話,惡心程度超出了想象。

「由於造謠成本低,他們甚至不需要完整圖片,只需要一張臉部圖片就能完成所有,而且很難被抓到,這使得他們更加肆意妄為。」妍妍說,從整個社會來看,也許需要更系統的治理。

Deepfake之惡何解?

正如妍妍所言,發生在身邊的Deepfake犯罪事件並非個案。

由英文「deep machine learning」(深度機器學習)和「fake photo」(假照片)組合而成的Deepfake(深度偽造),能基於人類行為特征如面部、聲音等合成影像、視訊、音訊。當前這一技術,正被濫用成為針對婦女暴力、詐騙犯罪的新前沿。

據新華社報道,南韓教育部9月9日說,南韓今年已發生400多起涉及中小學的相關案件,受害者累計超過600人。

與此同時,南韓使用者使用的社交媒體Telegram上,被發現存在多個傳播和分享該型別色情內容的群聊,其中已知最大的一個聊天室成員超過22萬人。這類性犯罪事件的受害者人數尚難以統計。已知的被波及群體,包括女學生、女教師和女兵等,其中包含大量未成年人。

另外,近段時間,在一些短視訊平台上,除了「AI名人」,「AI接吻視訊」也十分流行。有博主宣稱只需要下載一個軟體,花費9.9元就可以完成。看著兩個毫無關系的照片人物「活生生」親吻擁抱在一起,不少網友直呼可怕。

融力天聞律師事務所高級合夥人劉赤軍律師告訴潮新聞記者,Deepfake(深度偽造)之於視訊,就像Photoshop之於圖片,兩者都直觀沖擊了真實和虛擬之間的界限。但Deepfake能夠實作以極低的成本制作出完全虛構但極其逼真的視訊。

圖片來源:新華社

奇安信行業安全研究中心主任裴智勇告訴潮新聞記者,深度偽造,一般是指利用人工智慧技術,生成的高度逼真的視訊、音訊、圖片、文案等內容。這些內容多被用於網路欺詐、制造謠言、擾亂公共秩序和生成各類色情內容。由於這些偽造內容大多使用了人工智慧技術中的深度計算技術,且辨識難度很大。

「讓普通人用肉眼或耳朵來辨識深度偽造的視訊、音訊內容是不現實的,因為深度偽造本身就意味著難以辨識,沒有經過專業訓練的普通人很難從技術角度識破深度偽造內容。」裴智勇說。

在他看來,雖然想要阻止人們使用AI生成偽造視訊或圖片不現實,但這並不意味著對偽造視訊或圖片毫無辦法。「國內對於網路色情視訊和圖片都有非常成熟的治理方法,即便不能用技術鑒別一張圖片的真偽,但可以從平台一側阻止色情內容的傳播,定位色情內容的傳播源頭並實施打擊。」

在自拍、短視訊盛行的時代,想要讓普通公民少露臉、少出鏡,幾乎是不可能的。所以,裴智勇提醒道,當公眾遇到有人使用偽造視訊、音訊等內容對財產侵害、名譽損害時,最好的辦法還是及時報警或向平台進行舉報,減少深度偽造內容帶來的影響。

「轉載請註明出處」